IA: el final del «Ver para creer»

¡Atención, atención! 🚨 ¡Los deepfakes están invadiendo internet a una velocidad de vértigo! Según el Foro Económico Mundial, estos vídeos falsos están aumentando a un ritmo anual del 900%. ¡Sí, leíste bien, 900%! Y en Latinoamérica, el número de deepfakes se multiplicó por diez entre 2022 y 2023. ¡Es como si los deepfakes estuvieran en una maratón y no pudieran parar!

Ahora, hablemos de los sectores más afectados. Imagina que los deepfakes son como esos mosquitos molestos que no te dejan en paz. Pues bien, los sectores del periodismo, la política, el entretenimiento y las finanzas están siendo picoteados sin piedad. ¡Y el mercado de deepfakes podría alcanzar los 5134 millones de dólares para 2030! ¡Eso es mucho dinero para vídeos falsos!

En el mundo de la política, los deepfakes son como esos villanos de las películas que siempre tienen un plan malvado. Pueden crear vídeos falsos de políticos diciendo o haciendo cosas que nunca ocurrieron, difundiendo propaganda y desinformación. Esto puede influir en la opinión pública y hasta en el resultado de elecciones. ¡Es como si los deepfakes tuvieran su propio partido político!

Pero eso no es todo. La proliferación de deepfakes puede llevar a una mayor desconfianza en los medios de comunicación. Si no podemos confiar en la autenticidad de los vídeos, ¿cómo distinguimos entre la verdad y la mentira? Además, los deepfakes pueden atacar la reputación de figuras políticas, creando escándalos falsos que pueden dañar sus carreras y credibilidad. ¡Es como si los deepfakes fueran expertos en chismes!

Y no olvidemos la manipulación de la opinión pública. Los deepfakes pueden ser utilizados en momentos críticos, como antes de elecciones o durante crisis políticas, alterando la percepción de los eventos y decisiones políticas. ¡Es como si los deepfakes tuvieran su propio reality show!

En un contexto más amplio, los deepfakes pueden ser utilizados por actores estatales o no estatales para desestabilizar gobiernos, crear caos y socavar la seguridad nacional. ¡Es como si los deepfakes fueran agentes secretos con una misión muy peligrosa!

Por eso, la detección y mitigación de los deepfakes es crucial para proteger la integridad de los procesos democráticos y la confianza en las instituciones políticas. Las herramientas avanzadas de detección de deepfakes están en desarrollo para combatir estos riesgos y asegurar que la información que consumimos sea auténtica y veraz. ¡Es como si tuviéramos nuestros propios superhéroes tecnológicos luchando contra los deepfakes!

Herramientas de Detección

Existen diversas herramientas de detección de deepfakes que utilizan IA y análisis de datos para identificar manipulaciones. Algunas de estas herramientas incluyen Sentinel, Sensity, HyperVerge, FakeCatcher de Intel, y Microsoft Video AI Authenticator.

Las herramientas de detección de deepfakes utilizan una combinación de técnicas avanzadas de inteligencia artificial (IA) y análisis de datos para identificar manipulaciones en vídeos y audios. Aquí te explico algunos de los métodos más comunes:

Análisis de Píxeles y Artefactos: Estas herramientas examinan los píxeles y los artefactos en los vídeos para detectar inconsistencias que no serían visibles a simple vista. Los deepfakes a menudo tienen pequeñas imperfecciones en la textura de la piel, los bordes de los objetos y las sombras.

Detección de Inconsistencias en el Movimiento: Los deepfakes pueden tener movimientos anormales o poco naturales en las expresiones faciales y los gestos. Las herramientas de detección analizan estos movimientos para identificar patrones que no coinciden con los movimientos humanos naturales.

Análisis de Audio: Además del vídeo, el audio también puede ser manipulado. Las herramientas de detección analizan las características del audio, como el tono, la frecuencia y el ritmo, para detectar discrepancias que indiquen una manipulación.

Redes Neuronales Convolucionales (CNN): Estas redes son especialmente efectivas para analizar imágenes y vídeos. Las CNN pueden ser entrenadas con grandes conjuntos de datos de deepfakes y vídeos auténticos para aprender a distinguir entre ellos.

Modelos de Aprendizaje Profundo: Los modelos de aprendizaje profundo, como las redes generativas antagónicas (GAN), pueden ser utilizados tanto para crear como para detectar deepfakes. Estos modelos pueden identificar patrones sutiles que indican una manipulación.

Análisis de Metadatos: Los metadatos de los archivos de vídeo y audio pueden contener información sobre el origen y las modificaciones del archivo. Las herramientas de detección pueden analizar estos metadatos para identificar posibles manipulaciones.

Herramientas Específicas

Algunas herramientas populares de detección de deepfakes incluyen:

Sentinel: Utiliza IA para analizar vídeos y detectar deepfakes en tiempo real.

Sensity: Ofrece soluciones de detección de deepfakes para empresas y gobiernos.

HyperVerge: Utiliza análisis de imágenes y vídeos para identificar deepfakes.

FakeCatcher de Intel: Detecta deepfakes analizando los patrones de flujo sanguíneo en los rostros.

Estas herramientas están en constante evolución para mantenerse al día con las técnicas cada vez más sofisticadas utilizadas para crear deepfakes.

Importancia de la Detección

La detección de deepfakes es crucial para proteger contra los efectos dañinos de videos y audios falsos. La tecnología de detección está avanzando rápidamente para mantenerse al día con las técnicas de generación de deepfakes.

Así que, la próxima vez que veas un vídeo en internet, recuerda: ¡puede que no todo sea lo que parece! 😉

Y la peor parte…

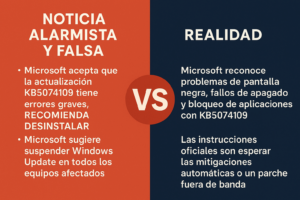

Nada de lo que acabás de leer fué escrito o siquiera pensado por persona alguna: sólo es el resultado de haber hecho un par de preguntas a Copilot (la IA de Microsoft) y pedirle que lo redacte con un tono poco formal. Lo mismo está sucediendo casi con cada cosa que lees en resúmenes de noticias y portales. Y aunque la mayoría de las herramientas de IA informan las fuentes utilizadas para generar los resultados, no todos los que las usan se toman el trabajo de verificarlas. De hecho, yo para este post casi experimental, no lo hice. Bien podría decir que 2+2 son 5, pero si lo dijo en un párrafo convincente, listo.

La educación e ilustración previa del lector sigue siendo la mejor, sino la única, herramienta detectora de deepfakes o pescado podrido, que así lo llamábamos cuando a las cosas las definíamos por lo que eran y no importaba si sonaba bonito.

Salute!